0

| 本文作者: AI研習(xí)社 | 2020-03-05 16:01 |

Social-STGCNN:一種用于行人軌跡預(yù)測的社會時空圖卷積神經(jīng)網(wǎng)絡(luò)

音頻驅(qū)動的帶自然頭部姿態(tài)的說話人臉視頻生成

用自適應(yīng)實例歸一化將學(xué)習(xí)從合成噪聲轉(zhuǎn)移到真實噪聲去噪

CookGAN:食材圖像合成

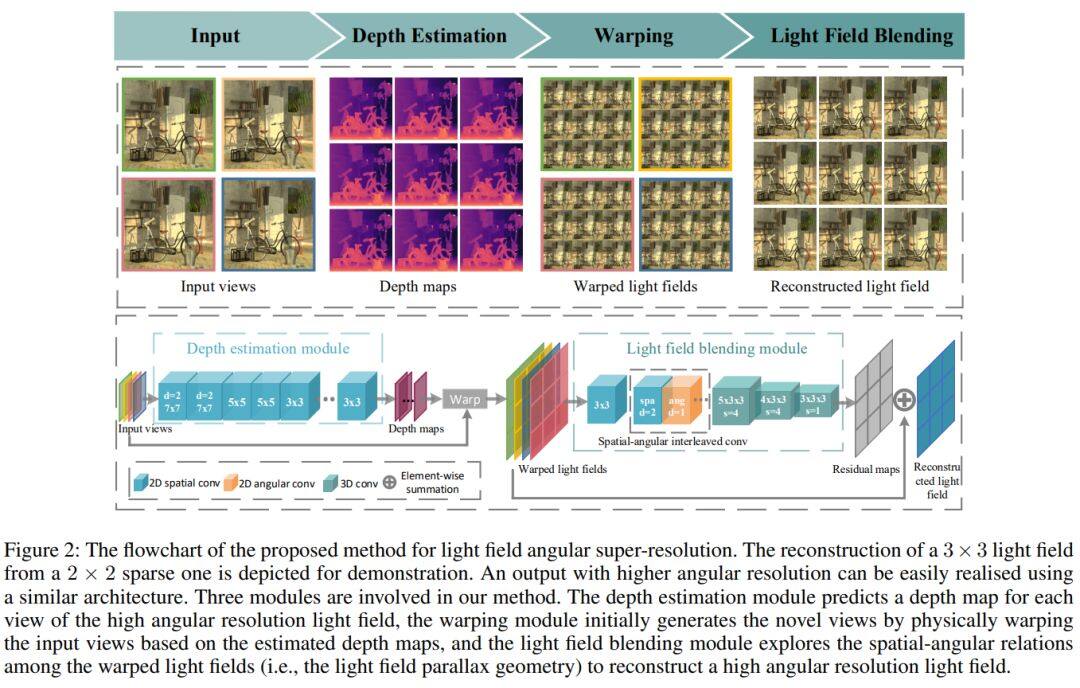

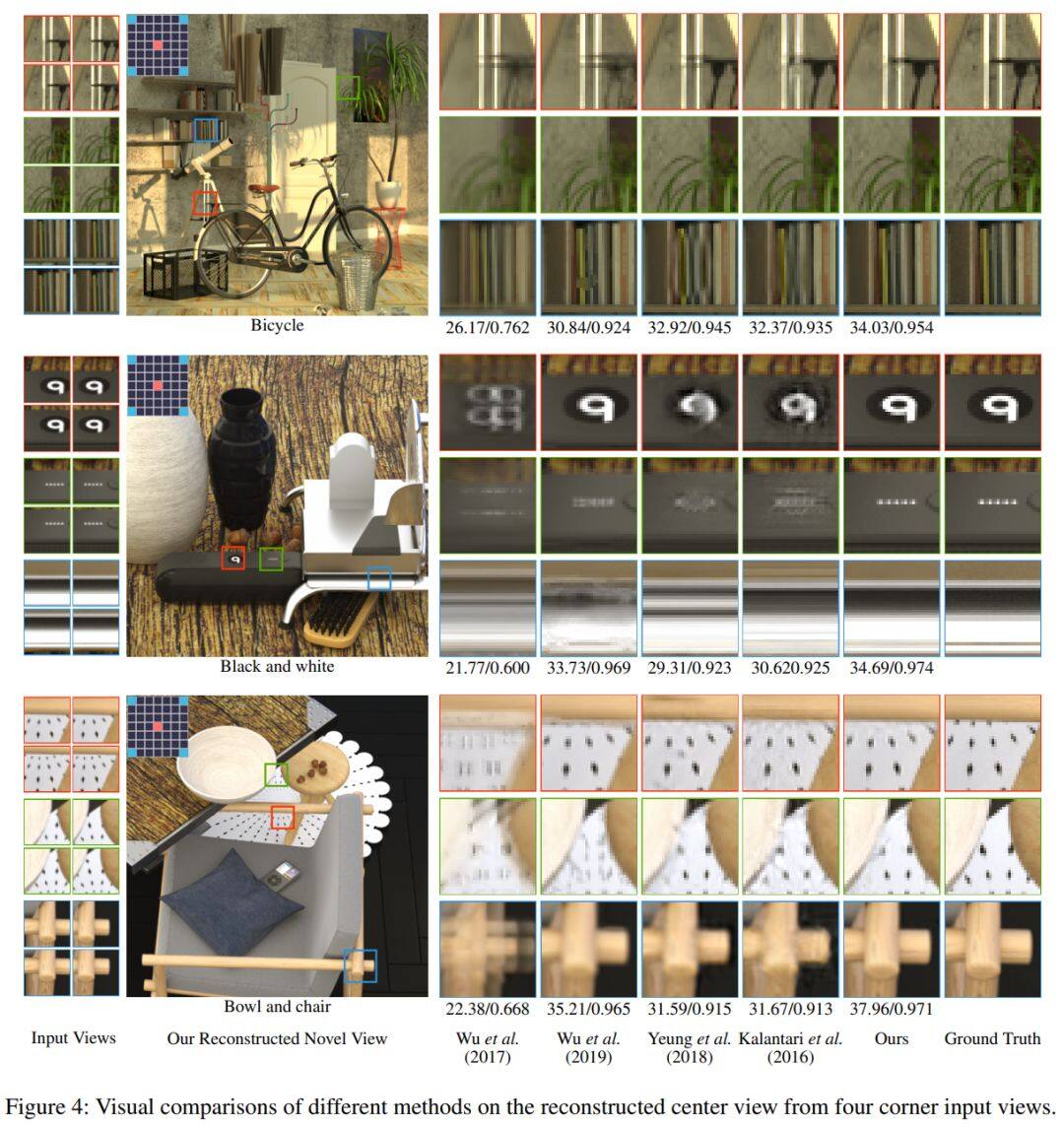

通過幾何感知網(wǎng)絡(luò)學(xué)習(xí)光場角度超分辨率

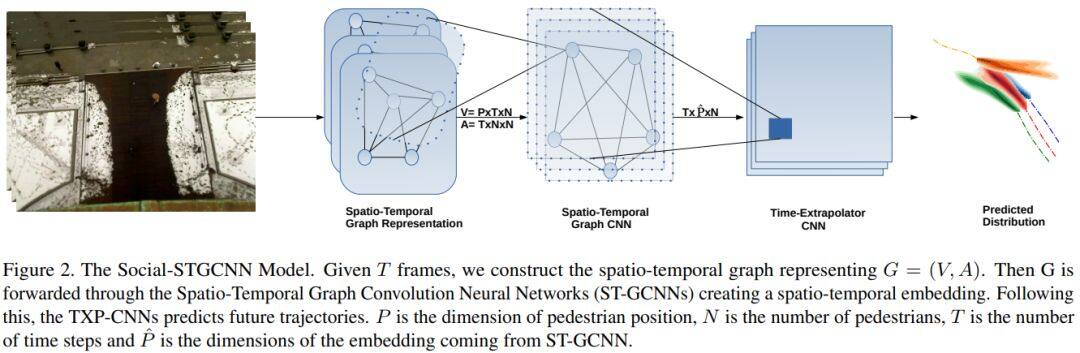

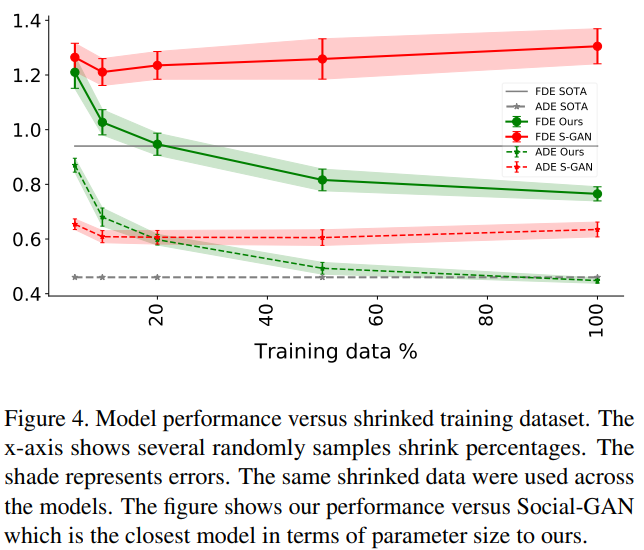

論文名稱:Social-STGCNN: A Social Spatio-Temporal Graph Convolutional Neural Network for Human Trajectory Prediction

作者:Mohamed Abduallah /Qian Kun /Elhoseiny Mohamed /Claudel Christian

發(fā)表時間:2020/2/27

論文鏈接:https://paper.yanxishe.com/review/12827?from=leiphonecolumn_paperreview0305

推薦原因

這篇論文被CVPR 2020接收,考慮的是行人軌跡預(yù)測的問題。

行人軌跡不僅受行人本身影響,還與周圍物體的相互作用有關(guān)。這篇論文提出了社會時空圖卷積神經(jīng)網(wǎng)絡(luò)(Social Spatio-Temporal Graph Convolutional Neural Network,Social-STGCNN),將行人與周圍物體的交互行為建模為圖模型,并通過一個核函數(shù)將行人之間的社交互動嵌入鄰接矩陣中。實驗結(jié)果表明,與先前方法相比,Social-STGCNN的最終位移誤差較現(xiàn)有技術(shù)提高了20%,參數(shù)減少了8.5倍,而推理速度提高了48倍。

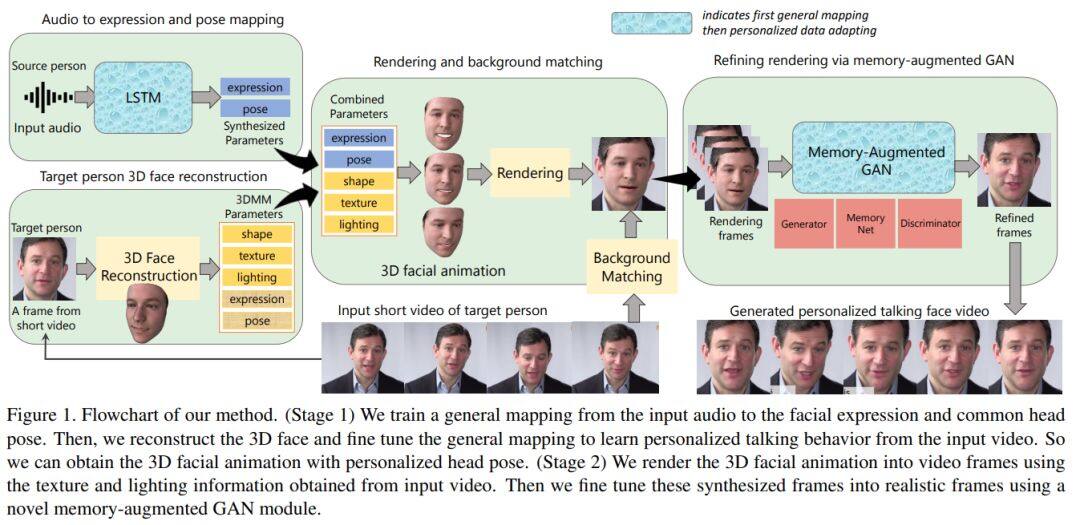

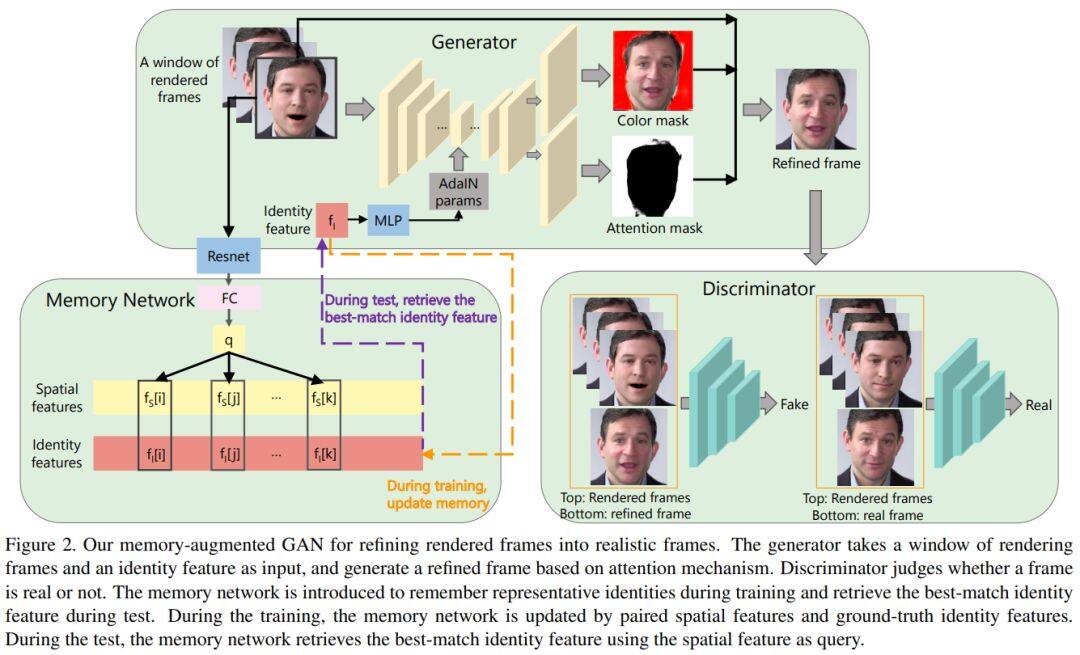

論文名稱:Audio-driven Talking Face Video Generation with Natural Head Pose

作者:Ran Yi /Zipeng Ye /Juyong Zhang /Hujun Bao /Yong-Jin Liu

發(fā)表時間:2020/2/24

論文鏈接:https://paper.yanxishe.com/review/12316?from=leiphonecolumn_paperreview0305

推薦原因

現(xiàn)實世界中說話的人臉通常伴隨著自然的頭部運動,但大多數(shù)現(xiàn)有的說話人臉視頻生成方法僅考慮具有固定頭部姿勢的人臉動畫。

本文通過提出一個深度神經(jīng)網(wǎng)絡(luò)模型來解決此問題,該模型將源人的音頻信號A和目標(biāo)人的非常短的視頻V作為輸入,并輸出合成的高質(zhì)量說話人臉視頻,其具有自然的頭部姿勢(利用V中的視覺信息),且表情和嘴唇同步(同時考慮A和V)。該項工作最大的挑戰(zhàn)是自然的頭部姿態(tài)包含平面內(nèi)外的頭部旋轉(zhuǎn),為了解決這個問題,作者重建出3D人臉動畫并將其重新渲染為視頻序列,為了平滑過渡這些視頻的背景圖使得結(jié)果更加逼真,作者提出了一個新穎的內(nèi)存增強的GAN模塊。

大量實驗和用戶調(diào)研表明,文章方法可以生成高質(zhì)量(即自然的頭部運動,表情和嘴唇的同步)個性化的說話人臉視頻,表現(xiàn)優(yōu)于 state-of-the-art 的方法。

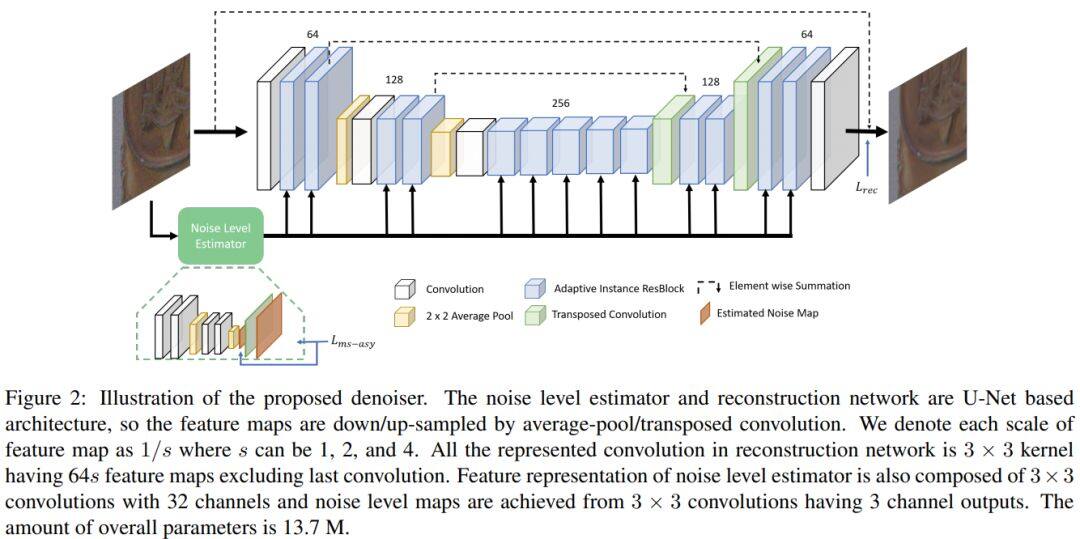

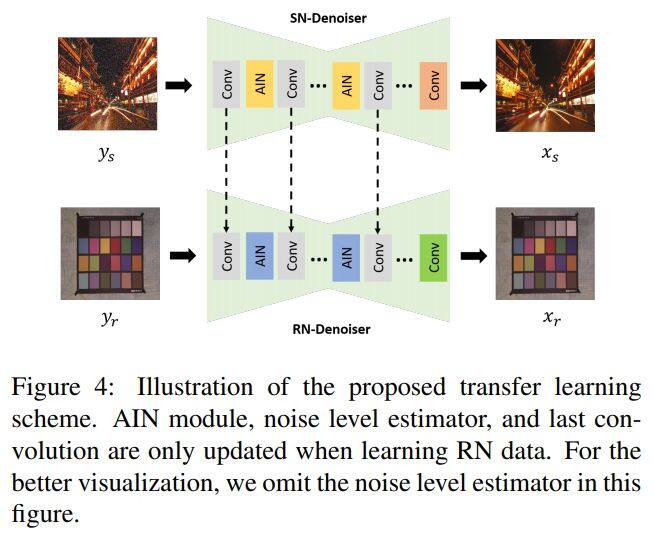

論文名稱:Transfer Learning from Synthetic to Real-Noise Denoising with Adaptive Instance Normalization

作者:Kim Yoonsik /Soh Jae Woong /Park Gu Yong /Cho Nam Ik

發(fā)表時間:2020/2/26

論文鏈接:https://paper.yanxishe.com/review/12691?from=leiphonecolumn_paperreview0305

推薦原因

這篇論文被CVPR接收,考慮的是真實噪聲的去噪問題。

這篇論文提出了一個廣義降噪結(jié)構(gòu)和遷移學(xué)習(xí)方案來應(yīng)對各種復(fù)雜的實際噪聲。這個方案采用自適應(yīng)實例規(guī)范化來構(gòu)建一個降噪器,可以正規(guī)化特征地圖,并且防止網(wǎng)絡(luò)過度擬合訓(xùn)練集。這篇論文還提出了一個遷移學(xué)習(xí)方法,可以將從合成噪聲數(shù)據(jù)中學(xué)習(xí)的知識遷移到真實噪聲領(lǐng)域。合成噪聲降噪器可以從各種合成噪聲數(shù)據(jù)學(xué)習(xí)一般特征,而真實噪聲降噪器可以從中學(xué)到真實數(shù)據(jù)的實時噪聲特性。新提出的去噪方法具有很強的泛化能力,在合成噪聲上訓(xùn)練的網(wǎng)絡(luò)能夠在Darmstadt Noise Dataset (DND)數(shù)據(jù)集上取得目前最好的性能結(jié)果。

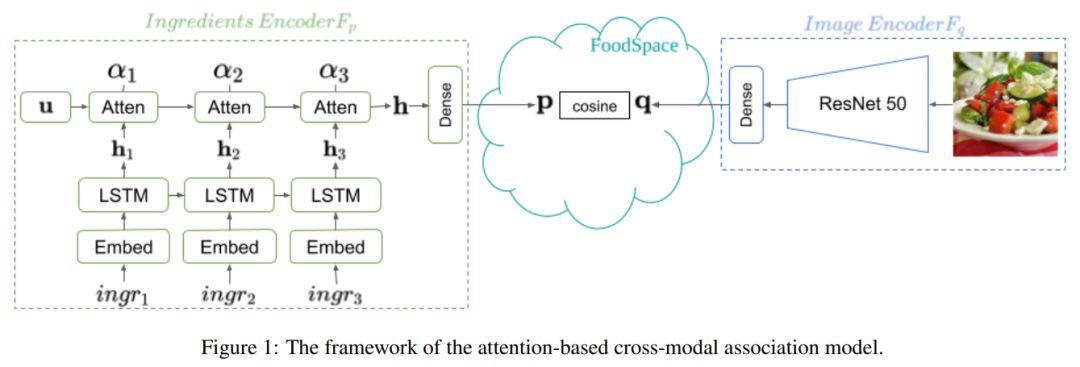

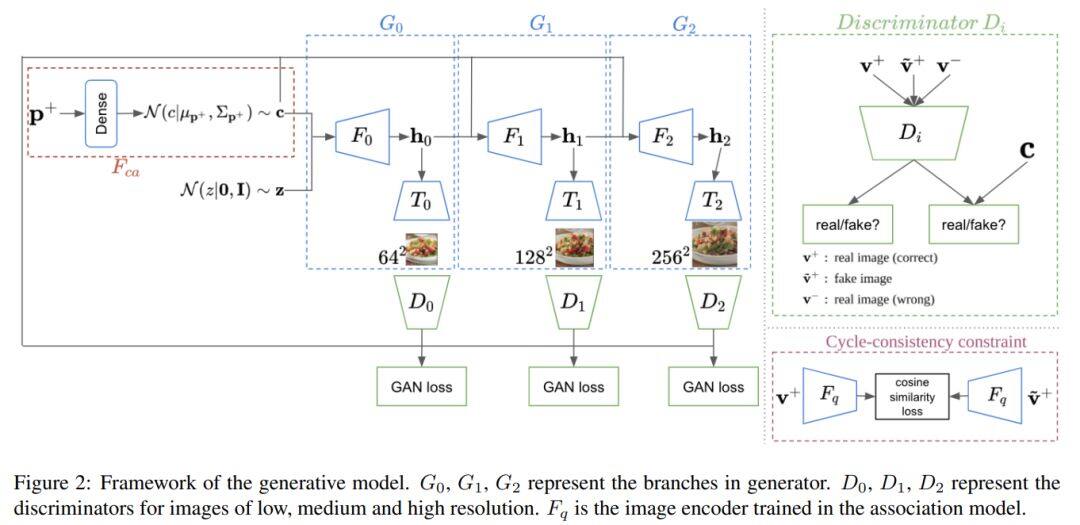

論文名稱:CookGAN: Meal Image Synthesis from Ingredients

作者:Han Fangda /Guerrero Ricardo /Pavlovic Vladimir

發(fā)表時間:2020/2/25

論文鏈接:https://paper.yanxishe.com/review/12690?from=leiphonecolumn_paperreview0305

推薦原因

這篇論文發(fā)表于WACV 2020,通過食材列表合成逼真的食品圖像。

以往利用生成對抗網(wǎng)絡(luò)進(jìn)行圖像生成的工作主要集中在生成空間緊湊且定義明確的物品上,而食品圖像則更加復(fù)雜,包含了多種食材成分,其外觀和空間品質(zhì)通過不同的烹飪方式會進(jìn)一步變化。為了從配料中生成真實的食品圖像,這篇論文提出了CookGAN,該模型首先建立一個基于注意力的配料-圖像關(guān)聯(lián)模型,然后將其用于調(diào)節(jié)生成合成食品圖像的神經(jīng)網(wǎng)絡(luò)。此外,CookGAN添加了周期一致約束以進(jìn)一步改善圖像質(zhì)量并控制外觀。實驗表明,CookGAN能生成與成分相對應(yīng)的食品圖像。

論文名稱:Learning Light Field Angular Super-Resolution via a Geometry-Aware Network

作者:Jin Jing /Hou Junhui /Yuan Hui /Kwong Sam

發(fā)表時間:2020/2/26

論文鏈接:https://paper.yanxishe.com/review/12689?from=leiphonecolumn_paperreview0305

推薦原因

這篇論文發(fā)表于AAAI 2020,考慮的是光場圖像超分辨率的問題。

目前有一些方法用以改善稀疏采樣光場的角分辨率,但這些方法主要關(guān)注基準(zhǔn)較小的光場,例如消費型光場相機。這篇論文提出一種端到端的學(xué)習(xí)方法,旨在對具有較大基準(zhǔn)的稀疏采樣光場進(jìn)行角度超分辨率處理。新方法包括兩個可學(xué)習(xí)模塊和一個基于物理的模塊:用于顯式建模場景幾何的深度估計模塊,用于新視圖合成的基于物理的屈折模塊,以及專門設(shè)計用于光場重建的光場混合模塊。此外,新方法引入一種新?lián)p失函數(shù)來促進(jìn)光場視差結(jié)構(gòu)的保存。在包括大基準(zhǔn)光場圖像在內(nèi)的各種光場數(shù)據(jù)集上的實驗結(jié)果表明,與當(dāng)前最佳技術(shù)相比,這篇論文所提的方法具有明顯優(yōu)勢,并且可以更好地保留光場視差結(jié)構(gòu)。

為了更好地服務(wù)廣大 AI 青年,AI 研習(xí)社正式推出全新「論文」版塊,希望以論文作為聚合 AI 學(xué)生青年的「興趣點」,通過論文整理推薦、點評解讀、代碼復(fù)現(xiàn)。致力成為國內(nèi)外前沿研究成果學(xué)習(xí)討論和發(fā)表的聚集地,也讓優(yōu)秀科研得到更為廣泛的傳播和認(rèn)可。

我們希望熱愛學(xué)術(shù)的你,可以加入我們的論文作者團隊。

加入論文作者團隊你可以獲得

1.署著你名字的文章,將你打造成最耀眼的學(xué)術(shù)明星

2.豐厚的稿酬

3.AI 名企內(nèi)推、大會門票福利、獨家周邊紀(jì)念品等等等。

加入論文作者團隊你需要:

1.將你喜歡的論文推薦給廣大的研習(xí)社社友

2.撰寫論文解讀

如果你已經(jīng)準(zhǔn)備好加入 AI 研習(xí)社的論文兼職作者團隊,可以添加運營小姐姐的微信(ID:julylihuaijiang),備注“論文兼職作者”

雷鋒網(wǎng)雷鋒網(wǎng)雷鋒網(wǎng)

相關(guān)文章:

今日 Paper | 點云分類框架;多模式Transformer;神經(jīng)網(wǎng)絡(luò);有序神經(jīng)元等

雷峰網(wǎng)原創(chuàng)文章,未經(jīng)授權(quán)禁止轉(zhuǎn)載。詳情見轉(zhuǎn)載須知。